INFO: Blog ini sudah discontinue sejak Desember 2018. Untuk info tutorial SEO terupdate silahkan ke halaman Belajar SEO di Kepointernet.com

Googlebot mengunjungi triliunan halaman web dan terus menerus mengunjungi halaman-halaman tersebut.

Apa itu WebCrawler?

Sebenarnya Webcrawlers yang juga disebut sebagai bots, robots, atau spiders, hanyalah sejenis software yang didesain untuk mengikuti tautan-tautan/links dan mengumpulkan data dari setiap link.Googlebot mengambil konten dari halaman-halaman web, seperti kata-kata, kode, dan sumberdaya yang menyusun halaman web tersebut.

Kalau di dalam konten yang diambilnya ada link menuju halaman lain, maka link-link itu akan dicatat.

Googlebot dan Website Anda

Informasi yang dikirimkan oleh Googlebot akan memperbarui index Google. Index inilah tempat di mana semua halaman web akan dibandingkan dan diberi ranking menurut kata kunci.Jadi langkah pertama agar halaman website anda bisa ada di dalam index ini adalah membuat website anda bisa terlihat dan bisa diakses oleh Googlebot.

Apakah Googlebot Bisa Melihat Halaman Web Saya?

Untuk mengetahui apa yang bisa dilihat oleh Googlebot dari situs anda, lakukan hal ini di pencarian Google. Masukkan pencarian berikut:site:namadomain.comIni adalah perintah untuk menampilkan semua halaman yang dikumpulkan Googlebot ke dalam Google index.

Dari sini anda bisa melihat ada berapa banyak halaman anda yang ada di dalam index Google. Apakah jumlahnya wajar, kurang, atau malah terlalu berlebihan?

Jika kurang, maka bisa saja ada halaman yang anda anggap seharusnya masuk ke dalam index Google malah secara tidak sengaja anda blokir dengan robots.txt.

Kalau berlebihan, maka bisa jadi ada halaman-halaman yang tidak anda inginkan masuk malah terindeks; atau bahkan website anda secara tidak sengaja membuat banyak duplikat konten karena sistem dari tema yang digunakan.

Mana saja yang terjadi di antara keduanya akan merusak SEO dari website anda.... Jika halaman yang terindeks kurang, maka kurang juga poin yang harusnya anda dapatkan; dan sebaliknya jika halaman yang terindeks berlebihan, maka poin setiap halaman juga menjadi lebih kecil karena pembaginya jadi lebih banyak....

Jadi jika anda baru pertama kali belajar SEO, maka mengamati index Google adalah salah satu hal yang harus anda pahami.

Apakah Google bisa mengakses semua konten dan tautan?

Tidak semua yang ada di dalam halaman kita bisa diakses oleh Google, jadi anda harus tahu apakah elemen penting dari halaman yang anda harapkan bisa membantu SEO bisa dilihat oleh Google.Ada banyak jenis masalah yang mengakibatkan Google tidak bisa melihat semua isi konten di dalam website kita. Beberapa di antaranya adalah:

- Diblokir robots.txt

- Link tidak terbaca (broken link)

- Memakai teknologi flash yang belum bisa dilihat Googlebot

- Kode yang error

- Link dinamis yang terlalu rumit

Jika anda mau mengetahui apakah semua komponen halaman anda bisa dilihat oleh Google, maka coba lakukan FETCH AND RENDER di Search console; lihat apakah Google bisa merayapi semuanya atau hanya sebagian.

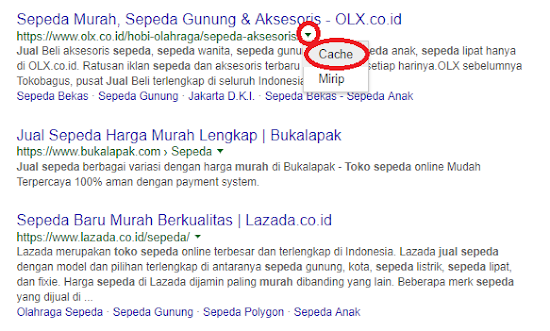

Atau anda bisa juga mencari halaman anda di Google dengan operator site: tadi, dan setelah hasil pencarian keluar, coba lihat CACHE Google dari panah kecil yang ada di setiap hasil pencarian (lihat gambar di bawah)

Bisakah Googlebot dikendalikan?

Ya, Google adalah perusahaan yang menghargai aturan di dalam robots.txt. Jadi robotnya tidak akan mengumpulkan data dari halaman-halaman yang dilarang.Secara keseluruhan ada beberapa cara anda bisa mengatur robot google:

- Memakai robots.txt

- Memasukkan meta robots di halaman

- Menggunakan instruksi robot di header

- Memakai peta situs

- Memakai Google Search Console

Tapi yang paling umum digunakan adalah robots.txt

Apa itu Robots.txt?

Ini adalah file yang berisi aturan bagaimana seharusnya robot perayap berinteraksi di halaman web anda. Yang perlu anda ketahui adalah;... hanya karena website anda menggunakan robots.txt bukan berarti semua robot akan mengikuti aturan yang ada di dalamnya.Robot dari pihak yang tidak baik tentu saja tidak akan mempedulikan aturan di dalam robots.txt ini.

Khusus Googlebot; anda bisa mengatur halaman mana yang boleh dan tidak boleh diakses oleh Googlebot saat datang ke website anda. Hanya saja pembahasan robots.txt ini cukup kompleks jadi akan dibahas nanti di artikel tersendiri.

Googlebot dan Peta Situs

Peta situs atau biasa disebut sitemap adalah cara untuk membantu google memahami struktur dari website anda.Google mengatakan ada beberapa kondisi di mana anda sangat perlu memakai peta situs...

- Anda membuat website yang sangat besar

- Website anda mempunyai banyak konten tapi saling terisolasi dan tidak mempunyai struktur link yang baik

- Situs anda masih baru dan hanya sedikit backlink yang masuk; jadi Google lebih mengandalkan peta situs untuk perayapan semua halaman baru.

Tipe-Tipe Googlebot

Googlebot mempunyai 9 tipe yang berbeda dengan fungsi yang berbeda pula. Kesembilan Googlebot tersebut adalah:- Googlebot (Google Web search)

- Google Smartphone

- Google Mobile (Feature phone)

- Googlebot Images

- Googlebot Video

- Googlebot News

- Google Adsense

- Google Mobile Adsense

- Google Adsbot (landing page quality check)

No comments:

Post a Comment